AIFrendz 학회 출범식 (12/8)

https://www.hellodd.com/news/articleView.html?idxno=95189 https://www.youtube.com/watch?v=AvL-RMw1RtM AI 프렌즈 단톡방 링크: https://open.kakao.com/o/ggewxi2 AI 프렌즈 블로그 링크: https://aifrenz.github.io AI 프렌즈 홈페이지: https://aifrenz.notion.site

"내가 윤석열로 보이니"… 'AI 정치인' 선거 혁신인가, 민주주의 재앙인가

https://www.hankookilbo.com/News/Read/A2021120816460003987

- 후보 아바타를 활용한 선거운동, 정치 윤리에 부합하나

- 사실과 거짓 혼용된 정보 유통, 가짜뉴스 악용 그 책임은?

- 미국과 유럽은 선거 운동에 딥페이크 활용 엄격 제한

- 유럽연합 인공지능법 초안의 핵심은 '신뢰'

첨단 조작 기술(deepfake), 인공지능용 학습데이터 분야의 국면 전환 요소로 급부상

https://www.korea.kr/news/pressReleaseView.do?newsId=156485475 https://www.kipo.go.kr/kpo/BoardApp/UnewPress1App?a=&board_id=press&cp=&pg=&npp=&catmenu=m03_05_01&sdate=&edate=&searchKey=&searchVal=&bunryu=&st=&c=1003&seq=19322

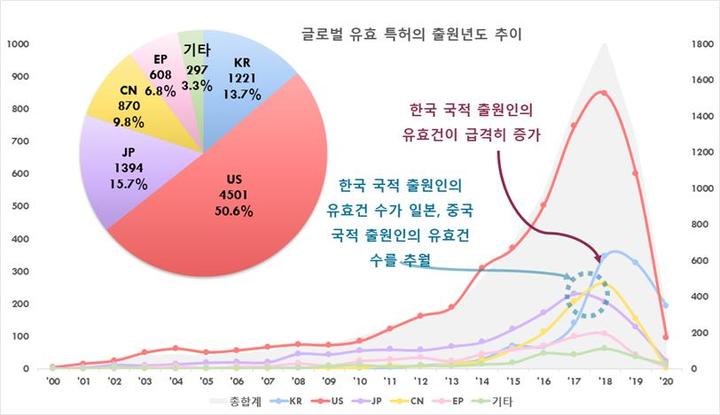

- 첨단 조작 기술 기반 AI 학습 관련 특허출원 연평균 135% 이상 증가

- 특허청은 오는 14일(화) 13시 30분 딥페이크 기반 데이터 증강 기술에 대한 특허분석 결과를 산업계와 공유 세미나

美 중국 인공지능(AI) 기업에 대한 투자 금지

https://www.kdfnews.com/news/articleView.html?idxno=84108

- 미 상무부는 10일(현지 시간) 중국 인공지능(AI) 기업 ‘센스타임(상탕커지·商湯科技)'을 ‘중국 군산 복합기업 명단’에 올리겠다고 발표

하버드 연구진 “中, 10년 안에 AI·5G 등 핵심분야서 美 따라잡을 것”

https://biz.chosun.com/international/international_general/2021/12/10/PI3AVCZXFBFFBJ7JZR6L3FWJI4/

- 하버드대 케네디스쿨의 싱크탱크인 벨퍼센터(Belfer Center)는 최근 펴낸 '거대한 기술 경쟁: 21세기의 중국과 미국'(“Great Technological Rivalry: : China vs. the U.S. in the 21st Century)

- 중국이 10년 안으로 △AI △5G △양자정보과학 △바이오기술 △반도체 △친환경에너지 등 21세기 핵심 기초 기술 분야에서 미국을 따라잡을 것이라며 이미 안면인식, 음성인식 핀테크 등 AI의 실용 분야에서 미국을 넘어섰다고 평가

- 중국은 2025년까지 과학과 기술공학, 수학 분야의 박사 학위 취득자를 미국보다 두 배 많이 배출할 것으로 예측

- 미·중 과학기술 전쟁, 2035년에 결판 난다 - https://www.joongang.co.kr/article/24103092#home

IBM Research, AI에게 기계 학습 모델 코딩을 가르치는 것을 목표로 하는 대규모 데이터 세트 'CodeNet' 소개

- CodeNet은 본질적으로 AI 시스템에 코드 해석 및 개선 방법을 가르치고 개발자가 더 빠르게 코딩할 수 있도록 지원하기 위한 광범위한 데이터 세트

- 가장 큰 질문은 컴퓨터가 스스로 프로그래밍할 수 있습니까? AI 시스템이 코딩을 하게 하는 것??

- 1,400만 개의 코드 샘플로 구성되어 있으며 55개 이상의 다른 언어에서 총 5억 줄의 코드를 제공

- C++, Java, Python 및 Go와 같은 현재 언어와 Pascal, FORTRAN 및 COBOL과 같은 이전 언어의 예가 포함 깃허브: https://github.com/IBM/Project_CodeNet 논문: https://openreview.net/pdf?id=6vZVBkCDrHT 참조: https://research.ibm.com/blog/codenet-ai-neurips-2021

신경망에 맬웨어를 숨길 수 있다고

https://bdtechtalks.com/2021/12/09/evilmodel-neural-networks-malware/

관련 - https://arxiv.org/abs/2107.08590

- AlexNet에 malware 삽입 시도 178MB 중 26.8MB의 malware 삽입. 정확도 1% 차이

- 모델의 정확도를 90% 이상으로 유지하면서 malware data 양을 36.9MB까지 늘릴 수 있었다고

- VGG, Resnet, Inception 및 Mobilenet을 비롯한 여러 다른 CNN 아키텍처에서 이 기술을 테스트했으며 유사한 결과 얻음

- 악성코드 임베딩이 대규모 신경망에 대한 보편적인 위협일 수 있음을 보여줌

Arxiv

Deepmind LM 연구 3부작

Scaling Language Models: Methods, Analysis, and Insights from Training Gopher

Ethical and social risks of harm from Language Models

Improving language models by retrieving from trillions of tokens

HairCLIP: Design Your Hair by Text and Reference Image

CLIP 을 활용하여 레퍼런스 이미지나 텍스트로 헤어스타일을 집중적으로 변환하는 모델

헤어칼라 interpolation 가능, 이미지 + 텍스트 description 가능, 스타일과 컬러별도 입력도 가능

역시 사람 얼굴을 그대로 유지하는 것은 여전히 숙제.. 어려운 얼굴각도도 숙제

https://github.com/wty-ustc/HairCLIP

Multimodal Conditional Image Synthesis with Product-of-Experts GANs

NVidia Ming-Yu Liu 그룹의 새로운 I2I 모델 (아마도 GauGAN2 를 위한 모델?)

텍스트, segmentation map, 스케치 그리고 이들의 조합으로 실사 이미지를 생성

https://deepimagination.cc/PoE-GAN/