Open sanoyo opened 5 years ago

これ量子化の話? 計算を軽くするために、Group-wise structureというものを採用している。 QBは、量子化されたブロックという意味。 この構造は、柔軟性があって、並列化が可能でハードウェアに優しいため、テスト時の推論で高速化が可能なようです。 ....................全然理解できず、英語直訳みたいになってしまった........

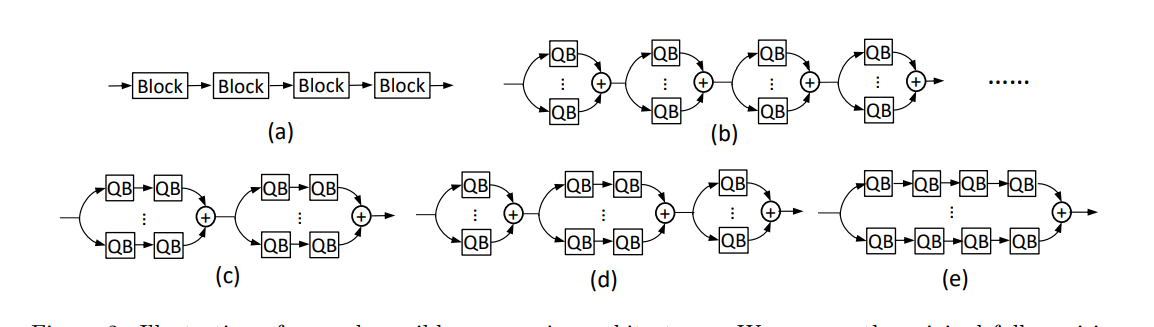

Group-wise structure

https://developer.smartnews.com/blog/2017/03/neural-network-quantization/ http://madoibito80.hatenablog.jp/entry/2018/04/06/121059 http://workpiles.com/2017/09/tensorflow-quantize-mnist/

https://arxiv.org/pdf/1808.02631.pdf

要約

これ量子化の話? 計算を軽くするために、

Group-wise structureというものを採用している。 QBは、量子化されたブロックという意味。 この構造は、柔軟性があって、並列化が可能でハードウェアに優しいため、テスト時の推論で高速化が可能なようです。 ....................全然理解できず、英語直訳みたいになってしまった........量子化参考になるリンク

https://developer.smartnews.com/blog/2017/03/neural-network-quantization/ http://madoibito80.hatenablog.jp/entry/2018/04/06/121059 http://workpiles.com/2017/09/tensorflow-quantize-mnist/

論文リンク

https://arxiv.org/pdf/1808.02631.pdf