classification23_taichi_pic.py是利用op保存的图片做预测这里读取的文件是marked_pictrain.txt (这个效果不理想,反应速度慢) 因此最后分别跑出了loss和acc曲线做对比,仅仅表明理论可行,但由于反应较慢(相较于骨骼坐标的预测来讲,前者几乎实时预测,而相较于图片的预测就很慢了)

classification23_taichi_eigenvalue.py是利用op提取的骨骼坐标做预测 ,就是通过getData函数读取保存的数据,这个数据的最后一维度代表太极姿态所属标签类别。

代码整体的思路就是

-

利用op获取骨骼坐标

-

将骨骼坐标进行处理,什么距离啊,角度啊等使得具有一定的手动提取的特征

-

将骨骼数据接入三层的全连接网络进行拟合训练出结果

-

利用PyQt以及OpenCV搭建界面,实时预测。

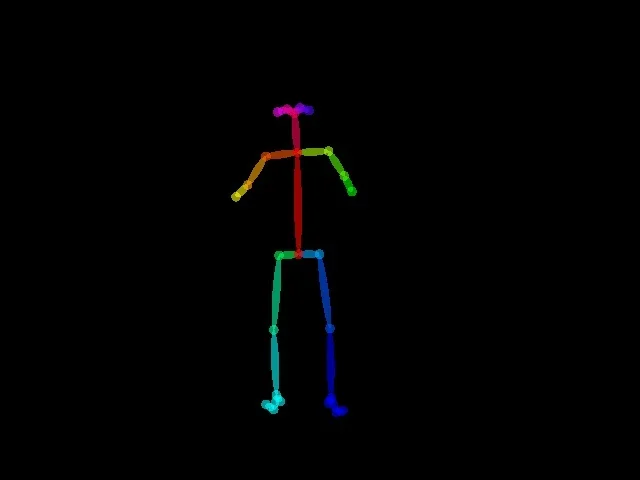

以上是主要的思路,随着项目的进行,需要采集数据,于是就演化出了采集系统。再接着发现op可以保存仅带有骨骼线条的图片,类似于下面的:

参考手写数字识别以及fashion_mnist的数据源,搭建了平行于基于特征值的卷积网络,也就是您的问题classification23_taichi_pic.py和predict_pic.py,而这个不是核心。

所以整个项目其实很简单

新手小白,想问下classification23_taichi_pic.py和predict_pic.py有什么用?我好像没有找到这两个文件的调用。不明白这两个文件是做什么用的?您的代码思路是不是这样:先用openpose做了关键点的提取,然后做了分类?可以这样理解吗?如果我理解有错,还请您多指导下。作为新手小白,问题有点多,希望您不要生气。。谢谢